L’ús ètic de la intel·ligència artificial, a debat

L’ús ètic de la intel·ligència artificial, a debat

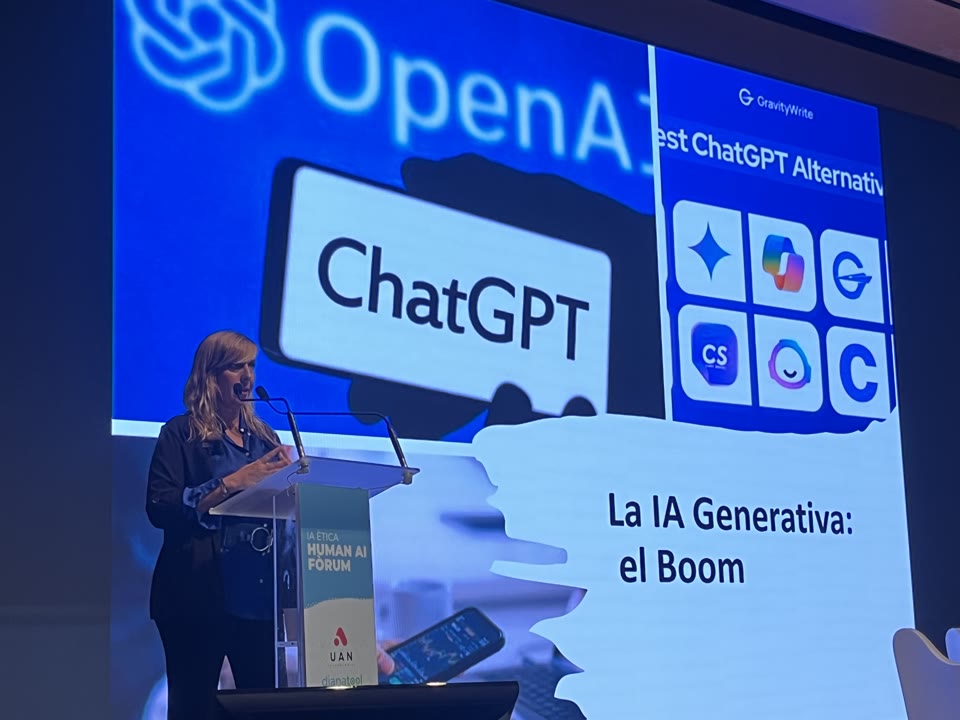

El TecnoCampus ha acollit aquest dijous el Human AI Fòrum, una trobada on s’ha volgut demostrar que es poden utilitzar de forma responsable eines com el xat GPT

El TecnoCampus ha acollit aquest dijous el Human AI Fòrum, una trobada on s’ha volgut demostrar que es poden utilitzar de forma responsable eines com el xat GPT

per Betty Doñate | Compartir

Que la intel·ligència artificial (IA) ha arribat per quedar-se és una realitat. I que té tants detractors com partidaris, també. A partir d’aquí, i amb l’objectiu de fer veure que es pot utilitzar la tecnologia intel·ligent de manera ètica, transparent i responsable, s’ha organitzat aquest dijous a Mataró el fòrum HumanAI.

La trobada, dirigida a estudiants, professionals, investigadors, empreses administracions, ha inclòs diverses taules rodones i ponències. Una d’elles ha estat la de la periodista Xantall Llavina, qui ha defensat les oportunitats que, al seu parer, poden sorgir al món laboral de la col·laboració amb les màquines.

Xantal Llavina, periodista: Ens ajuda als advocats, als periodistes, als comptables... Diuen que la IA traurà llocs de feina, no? Bé, traurà la feina de les tasques repetitives. Per posar-ho molt fàcil. Si fem una factura, serà més ràpida una màquina d’intel·ligència artificial. Si un humà només pot llegir 200 paraules al minut i la intel·ligència artificial, 30 llibres en un minut. Com una màquina no serà millor per col·laborar amb nosaltres.

També s’ha parlat de com identificar, mesurar i disminuir el biaix o l’error en els sistemes d’intel·ligència artificial. I de com la utilització de les eines digitals està transformant els models de negoci o la manera de fer de les empreses.

Ignasi Belda, director general de Agència Espanyola de Supervisió de la Intel·ligència Artificial: La regulació europea classifica els productes que contenen IA en quatre calaixos. Segons en quin calaix sigui l’aplicació, és una aplicació prohibida, d’alt risc mitjà o baix. Les empreses o els usuaris que estiguin utilitzant la IA han de ser conscients de quin risc té el seu producte, perquè a partir d’aquí s’han de prendre diferents accions.

Meritxell Borràs, directora de l'Autoritat Catalana de Protecció de Dades: Tots els sistemes d’IA hauran de complir amb el reglament general de protecció de dades. Això ens dona, com a l'Autoritat Catalana de Protecció de Dades, un rol, que és el control també d’aquests sistema d’intel·ligència artificial quan existeixen dades personals en joc.

El fòrum, organitzat per UAN Technologies i Diana Tool, s’ha ubicat al TecnoCampus per fer reflexionar sobretot els joves, que ja coneixen eines com el xat GPT, però que no sempre utilitzen la intel·ligència artificial de forma ètica.

Informa: B. Doñate

| Compartir